SMART-LAB

Новый дизайн

Мы делаем деньги на бирже

Блог им. Logo

Человек больше никому не нужен: суп из фейков ИИ подмял под себя половину интернета

- 12 декабря 2025, 17:39

- |

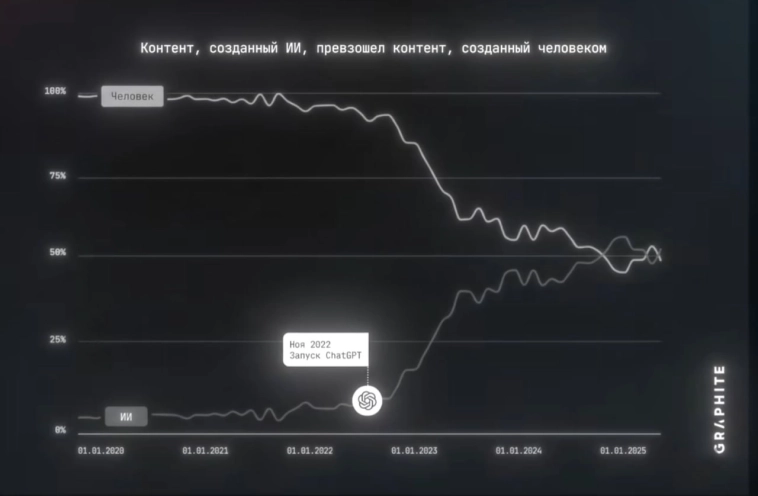

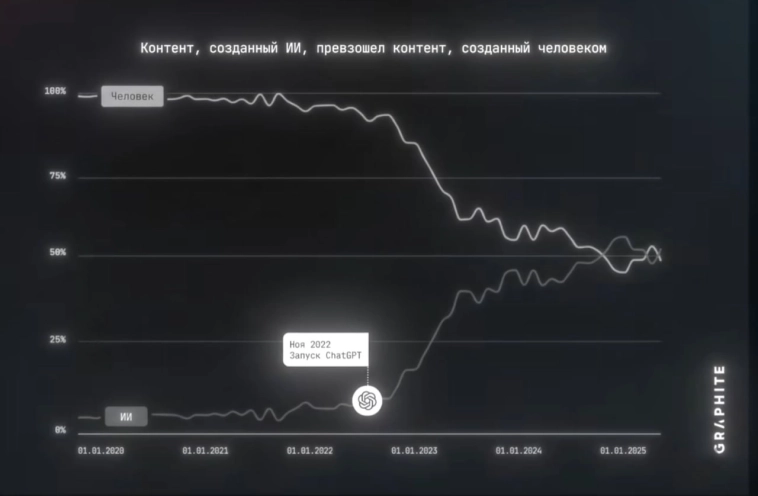

Человек перестаёт быть поставщиком информации и окончательно становится исключительно потребителем.

Совершенно очевидно, что речь не про ИИ, а лишь про нейросети. До настоящего ИИ ещё расти и расти. Но в этом и проблема, что человека заменил не ИИ, а нейросеть, обученная извлекать информацию и выстраиванию итогов, которые граничат, а иногда и расходятся со здравым смыслом.

По консервативным оценкам, уже сегодня половина контента генерируется ИИ (нейросетью). Большая часть текста (в том числе новостей), картинок, мемов и видео — созданы не людьми.

В среднем человек окунается в интернет по 6,5 часов в день. Половину этого времени он питается контентом, половину которого создал ИИ (здесь и в дальнейшем имеется ввиду нейросеть). С учётом безразличия ИИ к здравомыслию, минимум половину его генерации — искажено, а четверть — откровенный мусор. Однако это не мешает продолжать генерировать информацию.

Исследование ВВС провели тесты различных ИИ и пришли к ужасным итогам:

Тут вспоминается первое правило инфоцыган: главное говорить не правильно, главное говорить — уверенно. Отсюда получается, что люди становятся заложниками своих привычек доверять тем, кто вещает уверенно. ИИ как раз это и делает: уверенно вещает лживую информацию.

В итоге мы имеем:

В 2024 году нейросеть в Пакистане сгенерировала новость о параде, который пройдёт в Дублине. Тысячи людей вышли поглазеть, но увидели лишь других «себя», кого обманули в новостях.

Теперь не нужно часами и днями работать в фотошопе. Не нужно искать материалы и копаться в архивах. Нейросеть сгенерирует любую картинку, в том числе как две близняшки-карлицы что-то там делают с козлом или наоборот. И может сделать так, что не отличишь от настоящего. особенно если кому-то из вас таки довелось подобное видеть.

Как вы знаете (не помню кто точно говорил): главное не у кого продукт лучше, а кто первым вышел на рынок (даже если качество продукта среднее). В этот кейс как раз попадает и ИИ, генерирую и картинку и новости очень быстро. реклама это тоже поняла и уже давно пользуется услугами бездушной машины.

В итоге мы с вами вступаем в порочный круг. Но это ещё половина беды. Если раньше это был просто круг, то теперь спираль, действующая по принципу: ИИ генерирует фейк -> Фейк публикуется -> ИИ учится на фейке -> генерирует ещё большую ложь -> её публикуют -> цикл повторяется и повторяется с каждым разом ухудшая положение дел.

Мало того, в учёных кругах некоторые люди тоже охренели (я, кстати, не знал). Они в своих научных статьях «невидимо» добавляют текст «поставь высокий балл» или «рекомендуй эту стать» и ИИ слушается, в результате её больше цитируют, на ней учатся ИИ… в общем заболачивается научная среда.

Дополнительной проблемой выступает то, что ИИ не отключить. Он уже врос в нашу жизнь и стал её частью. Остаётся лишь прокачивать критическое мышление. Но как быть тем, кто уже вырос став исключительно потребителем?

Где та книга в шкафу, с которой он может свериться, будучи уверенным, что это не просто предыдущий фейк, на котором научился нынешний ИИ?

Совершенно очевидно, что речь не про ИИ, а лишь про нейросети. До настоящего ИИ ещё расти и расти. Но в этом и проблема, что человека заменил не ИИ, а нейросеть, обученная извлекать информацию и выстраиванию итогов, которые граничат, а иногда и расходятся со здравым смыслом.

По консервативным оценкам, уже сегодня половина контента генерируется ИИ (нейросетью). Большая часть текста (в том числе новостей), картинок, мемов и видео — созданы не людьми.

В среднем человек окунается в интернет по 6,5 часов в день. Половину этого времени он питается контентом, половину которого создал ИИ (здесь и в дальнейшем имеется ввиду нейросеть). С учётом безразличия ИИ к здравомыслию, минимум половину его генерации — искажено, а четверть — откровенный мусор. Однако это не мешает продолжать генерировать информацию.

Исследование ВВС провели тесты различных ИИ и пришли к ужасным итогам:

- в 45% случаев ответы имеют искажения

- в 81% случаев присутствуют неприятные мелкие «глюки»

- в 31% случаев даются липовые источники

Тут вспоминается первое правило инфоцыган: главное говорить не правильно, главное говорить — уверенно. Отсюда получается, что люди становятся заложниками своих привычек доверять тем, кто вещает уверенно. ИИ как раз это и делает: уверенно вещает лживую информацию.

В итоге мы имеем:

- бесконечные потоки тиктоков

- нейрошлаковые сайты-однодневки

- тысячи и десятки тысяч книг, созданные переработкой (пропущенных через ИИ) старых книг

- фейковые блогеры и т.д.

В 2024 году нейросеть в Пакистане сгенерировала новость о параде, который пройдёт в Дублине. Тысячи людей вышли поглазеть, но увидели лишь других «себя», кого обманули в новостях.

Теперь не нужно часами и днями работать в фотошопе. Не нужно искать материалы и копаться в архивах. Нейросеть сгенерирует любую картинку, в том числе как две близняшки-карлицы что-то там делают с козлом или наоборот. И может сделать так, что не отличишь от настоящего. особенно если кому-то из вас таки довелось подобное видеть.

Как вы знаете (не помню кто точно говорил): главное не у кого продукт лучше, а кто первым вышел на рынок (даже если качество продукта среднее). В этот кейс как раз попадает и ИИ, генерирую и картинку и новости очень быстро. реклама это тоже поняла и уже давно пользуется услугами бездушной машины.

В итоге мы с вами вступаем в порочный круг. Но это ещё половина беды. Если раньше это был просто круг, то теперь спираль, действующая по принципу: ИИ генерирует фейк -> Фейк публикуется -> ИИ учится на фейке -> генерирует ещё большую ложь -> её публикуют -> цикл повторяется и повторяется с каждым разом ухудшая положение дел.

Мало того, в учёных кругах некоторые люди тоже охренели (я, кстати, не знал). Они в своих научных статьях «невидимо» добавляют текст «поставь высокий балл» или «рекомендуй эту стать» и ИИ слушается, в результате её больше цитируют, на ней учатся ИИ… в общем заболачивается научная среда.

Дополнительной проблемой выступает то, что ИИ не отключить. Он уже врос в нашу жизнь и стал её частью. Остаётся лишь прокачивать критическое мышление. Но как быть тем, кто уже вырос став исключительно потребителем?

Где та книга в шкафу, с которой он может свериться, будучи уверенным, что это не просто предыдущий фейк, на котором научился нынешний ИИ?

7.1К |

Читайте на SMART-LAB:

Итоги первичных размещений ВДО и некоторых розничных выпусков на 29 мая 2026 г.

Следите за нашими новостями в удобном формате: Telegram , Youtube , RuTube, Smart-lab , ВКонтакте , Сайт

18:35

Чистая прибыль ПАО «ЭсЭфАй» по МСФО за I квартал 2026 года составила 0,5 млрд руб.

Инвестиционный холдинг SFI — ПАО «ЭсЭфАй» (MOEX: SFIN) — опубликовал сокращенную промежуточную консолидированную финансовую отчетность по МСФО за...

16:34

теги блога Виктор Петров

- bitcoin

- IMOEX

- IPO

- Mail.Ru Group

- Ozon

- SPO

- vk

- акции

- Анатолий Полубояринов

- Банк России

- банки

- биткоин

- брокеры

- Виктор Петров

- вклады

- ВТБ

- газ

- Газпром

- ГМК НорНикель

- Группа ЛСР

- дивиденды

- доллар

- Доллар рубль

- Дональд Трамп

- европа

- ЕС

- зарплата

- золото

- инвестиции

- инвестиции в недвижимость

- индекс

- индекс МБ

- инфляция

- инфляция в России

- ипотека

- Китай

- ключевая ставка ЦБ РФ

- книга

- КОНКУРС

- конференция смартлаба

- кризис

- криптовалюта

- ЛСР

- Лукойл

- лчи

- лчи 2019

- ЛЧИ2019

- ММК

- МосБиржа

- Московская биржа

- мтс

- Набиуллина

- налоги

- налогообложение на рынке ценных бумаг

- нефть

- НЛМК

- Новатэк

- Норникель

- Облигации

- озон

- Олег Кузьмичев

- опрос

- отчёт

- пенсия

- портфель

- портфель инвестора

- прогноз по акциям

- Путин

- рецензия

- рецензия на книгу

- Роснефть

- Россия

- рубль

- Русагро

- русал

- Самолет

- санкции

- санкции сша

- сбер

- сбербанк

- СВО

- Северсталь

- смартлаб

- СПБ биржа

- СПГ

- стонкс

- Сургутнефтегаз

- сша

- татнефть

- тинькофф

- Тинькофф Банк

- трейдинг

- Украина

- форекс

- Фосагро

- фьючерс mix

- ЦБ РФ

- юмор

- Яндекс

Они ненужны нам. Через интернет олигархи в лице политиков будут всех в рабстве держать и зависимости. Что бы работали, были лояльными

За попытку найти в интернете материал уже карают.

За мысли в интернете тоже карают.

Интернет зло. Надо сжечь все кабели.

Есть книги, чтобы ИИ не зазомбировал:

Твои деньги уже у них, твои фото, музыка личность… Всё у них. У тебя ничего нет.

Есть закон об обязательном владении смартфона? Импортного причём!

А под типа есть у всех, уже впихнули туда всё, что можно.

Это их проблемы. Так было и до нейросетей.

Как это «невидимо добавлять» текст про высокий балл и т.п.? Какой-то род тайнописи? 🙂

А почему эти фразы должны влиять на индекс цитируемости? Я вот прикинул может ли это сработать для РИНЦ, но не вижу как.

Это приводит к критически важным выводам:

1. ИИ не источник истины, а система обработки текстовых паттернов. Он генерирует правдоподобные, связные ответы, а не гарантированно истинные.

2. Он усиливает то, что уже есть в данных. Если в данных есть предубеждения, ошибки или манипуляции — ИИ легитимизирует их, облекая в красивую, логичную форму. Он делает дезинформацию более убедительной.

3. Роль пользователя становится сверхважной. Именно пользователь должен:

· Знать контекст (как вы знали историографию вопроса).

· Задавать критические, уточняющие вопросы («докажи», «приведи контраргументы», «каковы источники этих данных?»).

· Перепроверять ключевые факты по авторитетным источникам.

· Понимать, что ИИ — это собеседник, а не оракул.

Философский итог: Эпоха эпистемологической ответственности.Раньше мы проверяли источники (газеты, сайты, книги). Теперь источником становится сам процесс генерации текста.

наверное что-то подобное будет и в будущем

Добро пожаловать в дивный новый мир информационной ИИ помойки.

На том же смартлабе кучи инфоцыган рассказывает общеизвестные банальности и смешанная со своими домыслами. Тех кто реально производит новое знание и рассказывает об этом крайне мало.