о1: почему новая GPT от OpenAI — это не хайп, а переход к новой парадигме в ИИ

Последние пару лет развитие языковых нейросетей как будто бы шло по принципу «больше, длиннее, жирнее»: разработчики пытались раздуть свои модели на как можно большее число параметров и прогнать через них максимальный объем тренировочных данных. 12 сентября OpenAI выпустили новую LLM, которая добавляет в это уравнение еще одно измерение для прокачки: теперь можно масштабировать объем «мыслей», который модель будет тратить в процессе своей работы. В этой статье мы разберемся, чему научилась новая GPT o1, и как это повлияет на дальнейшую эволюцию ИИ.

/>

Эрмира «Мира» Мурати – албанская инженерка, которая занимает должность CTO OpenAI

Это гостевая статья от Игоря Котенкова, автора прекрасного канала Сиолошная про нейросети и космос. Я в данном случае выступаю только в качестве редактора. =)

В конце прошлой недели OpenAI анонсировали и сразу же выпустили новую модель. Вопреки ожиданиям, её назвали не GPT-5, а o1. Компания утверждает, что для них сброс счётчика линейки моделей к единичке знаменует собой переход к новой парадигме, и что эта нейросеть и вовсе демонстрирует новый уровень возможностей ИИ. Возможностей, ранее вызвавших переживания и опасения у некоторых внутренних исследователей OpenAI — да настолько, что они пожаловались совету директоров! Давайте разберёмся, что же именно произошло, как и почему появилась o1, и попытаемся понять, как правильно выстроить ожидания от этой LLM (большой языковой модели).

Предыстория, ожидания и исторический контекст

Ух, ну и наделал этот релиз шуму! Куда без этого — ведь o1 есть ни что иное как первый публичный показ «супер-прорывной технологии» от OpenAI под кодовым названием Strawberry (клубника). Вокруг неё в последний год ходило множество слухов — как адекватных, так и не очень. На форумах и в Твиттере была куча обсуждений, предвосхищений и хайпа, на фоне которых планка ожиданий некоторых людей взлетела до небес. Для тех, кто оградил себя от всего этого, вкратце перескажем контекст, ибо он очень важен. Итак:

🐌 22 ноября 2023 года. The Information (издание, публиковавшее инсайдерскую информацию про OpenAI несколько раз) выпускает материал под названием «OpenAI совершила прорыв в области ИИ перед увольнением Сэма Альтмана, что вызвало волнение и беспокойство».

Действительно, 17 ноября произошли странные события с увольнением одним днём исполнительного директора компании без объяснения причин. Несколько исследователей уволились в знак солидарности, а остальные запустили открытое письмо, требующее либо объяснений и прозрачности, либо восстановления должности. Через неделю 2 члена совета директоров были выставлены на улицу, Сэма вернули — и пошли отмечать Рождество.

В статье утверждается, что в течение нескольких недель до этого внутри OpenAI распространялась демо-версия некой новой технологии, которая и вызывала беспокойства. Мол, это настоящий прорыв, который ускорит разработку ИИ и потенциально может привести к катастрофе.

Впервые озвучивается название технологии: Q*. В интернете начинается обмен догадками, что же это означает — в мире машинного обучения есть технологии со схожими названиями (Q-learning для обучения игре в видеоигры и A*, пришедший из информатики).

🐌 23 ноября 2023 года. Reuters пишут, что накануне четырехдневного «путча» с увольнениями несколько штатных исследователей написали совету директоров письмо, предупреждающее о значительном открытии в области ИИ, которое, по их словам, может угрожать человечеству. Во внутренней переписке компании представитель OpenAI в обращении к сотрудникам подтвердил существование проекта Q* и факт написания некоторого письма с выражением беспокойства в адрес совета директоров.

🐌 11 июля 2024 года. Издание Bloomberg рассказало, что в ходе внутренней демонстрации OpenAI показали концепцию из пяти уровней, помогающую отслеживать прогресс в создании ИИ. Диапазон варьируется от знакомого ChatGPT (уровень 1 — чатбот, поддерживающий беседу), до ИИ, который может выполнять работу целой организации (уровень 5 — кооперация, долгосрочное планирование, исполнение).

/>

Вот такая табличка из пяти уровней. По ней можно строить догадки, куда же OpenAI двинется дальше.

По словам источника, руководители OpenAI сообщили сотрудникам, что в настоящее время они находится на пороге достижения второго уровня, который называется «Reasoners» (на русский хорошего перевода в одно слово нет, что-то вроде «сущность, которая размышляет и рассуждает»).

На этой же встрече было проведено демо новой технологии, «демонстрирующей некоторые новые навыки, схожие с человеческим мышлением». Уже понимаете, откуда растут ноги у ожиданий? :)

🐌 12 июля 2024 года. В эксклюзивном материале Reuters раскрываются некоторые детали, видимо, от сотрудников, присутствовавших на внутренней демонстрации: Проект Q* теперь называется Strawberry. Система якобы решает 90% задач из датасета MATH, в который входят олимпиадные задачи по математике для средней-старшей школы. Их собирали с разных туров (например, AIME), проводимых в США в рамках выявления членов команды для финалов международной олимпиады.

/>

Пример двух задачек разного уровня. Всего таких 12500 — и для каждой написано пошаговое решение и дан ответ (он обведён в прямоугольник) — но они, конечно, не даются модели во время работы, и используются для сверки результатов.

🐌 7 августа 2024 года. Сэм Альтман, СЕО OpenAI, подогревает интерес начитавшейся новостей публики фотографией клубнички (или земляники?).

🐌 27 августа 2024 года. The Information, с которых и началась вся эта история, пишет, что OpenAI провели демонстрацию технологии американским чиновникам по национальной безопасности. В этой же статье раскрываются некоторые из планов на будущее касательно GPT-5, но к ним мы ещё вернемся.

🐌 12 сентября 2024 года. OpenAI анонсируют o1, констатируя смену парадигмы, рекорды качества по множеству замеров на разных типах задач. Физика, математика, программирование — везде прогресс.

А теперь представьте, что вы это всё прочитали, настроились, на хайпе, идёте в ChatGPT проверять, спрашиваете какой-нибудь пустяк, ну например сколько букв в слове Strawberry, и видите… вот это:

/>

¯\_(ツ)_/¯

Казалось бы, Ватсон, дело закрыто, всё понятно: снова обман от циничных бизнесменов из Силиконовой долины, никаких прорывов, одно разочарование. Но не спешите с выводами (а вообще, если у вас есть подписка ChatGPT Plus, то лучше пойти попробовать самим на других задачах — модель уже доступна всем). До причин того, почему так происходит, мы ещё дойдём.

Официальное позиционирование

Для начала давайте посмотрим, на что делается упор в презентуемых результатах: чем именно OpenAI хотят нас удивить? Вот график с метриками (замерами качества) на трёх разных доменах:

/>

На всех трёх частях бирюзовый цвет означает результаты предыдущей лучшей модели OpenAI, gpt4o, оранжевый — раннюю, а малиновый — полноценную законченную версию модели o1. Есть ещё салатовый, о нём ниже. Полузакрашенные области сверху колонок на первой и третьей частях графика — это прирост в качестве за счёт генерации не одного ответа на задачу, а выбора самого популярного из 64. То есть, сначала модель независимо генерирует десятки решений, затем из каждого выделяется ответ, и тот, который получался чаще других, становится финальным — именно он сравнивается с «золотым стандартом».

Даже не зная, что это за типы задач спрятаны за графиком, невооружённым взглядом легко заметить скачок. А теперь приготовьтесь узнать его интерпретацию, слева направо:

AIME 2024: те самые «олимпиадные задачи по математике», взятые из реального раунда 2024 года (почти наверняка модель их не видела, могла изучать только схожие) — задачи там сложнее, чем в примерах на картинках выше. AIME является вторым в серии из двух туров, используемых в качестве квалификационного раунда Математической олимпиады США. В нём участвуют те, кто попал в топ-проценты первого раунда, примерно 3000 человек со всей страны.

Кстати, если модель попросить сгенерировать ответ не 64, а 1000 раз, и после этого выбирать лучший ответ не тупо как самый часто встречающийся, а с помощью отдельной модели, то o1 набирает 93% баллов — этого хватит, чтобы войти в топ-500 участников и попасть в следующий тур.

CodeForces: это сайт с регулярно проводимыми соревнованиями по программированию, где участникам предлагается написать решение на скорость. Тут LLM от OpenAI действовала как обычный участник и могла сделать до 10 отправок решения. Цифра на картинке — это процент людей-участников, набравших балл меньше, чем o1. То есть, например, 89,0 означает, что модель вошла в топ-11% лучших — сильный скачок относительно gpt4o, которая тоже попадает в 11% (правда, худших).

GPQA Diamond: самый интересный датасет. Тут собраны вопросы по биологии, физике и химии, но такие, что даже PhD (кандидаты наук) из этих областей и с доступом в интернет решают правильно всего 65% (тратя не более получаса на каждую задачу). Столбик салатового цвета с отметкой 69,7% указывает на долю задач, решённых людьми с PhD, отдельно нанятыми OpenAI — это чуть больше, чем 65% от самих авторов задач, но меньше, чем у передовой модели.

Для таких сложных задач подготовить хорошие ответы — это целая проблема. Если даже кандидаты наук не могут с ними справиться, используя интернет, то важно убедиться в корректности всех решений. Чтобы это сделать, проводилась перекрёстная проверка несколькими экспертами, а затем они общались между собой и пытались найти и исправить ошибки друг у друга. Кандидаты наук из других областей (то есть, условно, когда математик пытается справиться с задачей по химии, но использует при этом гугл) тут решают вообще лишь 34%.

Такие существенные приросты качества по отношению к gpt4o действительно приятно удивляют — не каждый день видишь улучшение в 6–8 раз! Но почему именно эти типы задач интересны OpenAI? Всё дело в их цели — помимо чатботов они заинтересованы в создании системы, выполняющей функции исследователей и инженеров, работающих в компании.

Посудите сами: для работы в OpenAI отбирают только первоклассных специалистов (и платят им много деняк), что накладывает существенные ограничения на темпы роста. Нельзя взять и за месяц нанять ещё десять тысяч людей, даже если зарплатный фонд позволяет. А вот взять одну модель и запустить в параллель 10'000 копий работать над задачами — можно. Звучит фантастично, но ребята бодро шагают к этому будущему. Кстати, если интересно узнать про тезис автоматизации исследований — очень рекомендую свою 70-минутную лекцию (станет прекрасным дополнением этого лонга) и один из предыдущих постов на Хабре.

/>

Так вот, поэтому им и интересно оценивать, насколько хорошо модель справляется с подобными задачами. К сожалению, пока не придумали способов замерить прогресс по решению реальных проблем, с которыми исследователи сталкиваются каждый день — и потому приходится использовать (и переиспользовать) задания и тесты, заготовленные для людей в рамках образовательной системы. Что, кстати, указывает, что последнюю 100% придётся менять уже прямо сейчас — в чём смысл, если все домашки и контрольные сможет прорешать LLM? Зачем игнорировать инструмент? Но это тема для отдельного лонга...

Третий из разобранных набор данных, GPQA Diamond, был как раз придуман меньше года назад (!) как долгосрочный бенчмарк, который LLM не смогут решить в ближайшее время. Задачи подбирались так, что даже с доступом в интернет (ведь нейронки прочитали почти все веб-страницы и набрались знаний) справится не каждый доктор наук! И вот через 11 месяцев o1 уже показывает результат лучше людей — выводы о сложности честной оценки моделей делайте сами.

Важно оговориться, что эти результаты не означают, что o1 в принципе более способна, чем доктора наук — только то, что модель более ловко решает конкретно некоторый тип задач, которые, как ожидается, должны быть по силам людям со степенью PhD.

А как модели решают такие задачи?

Начнём с примера: если я спрошу вас «дважды два?» или «столица России?», то ответ последует незамедлительно. Иногда просто хватает ответа, который первым приходит в голову (говорят «лежит на подкорке»). Никаких рассуждений не требуется, лишь базовая эрудиция и связь какого-то факта с формой вопроса.

А вот если задачка со звёздочкой, то стоит начать мыслительный процесс — как нас учили решать в школе на уроках математики или физики. Можно вспомнить какие-то формулы или факты, релевантные задаче, попытаться зайти с одного конца, понять, что попытка безуспешна, попробовать что-то другое, заметить ошибку, вернуться обратно… вот это всё, что у нас происходит и в голове, и на листе бумаге, всё то, чему учили на уроках.

Большие языковые модели практически всегда «бегут» только вперёд, генерируя по одному слову (или вернее части слова, токену) за раз. В этом смысле процесс их «мышления» очень отличается.

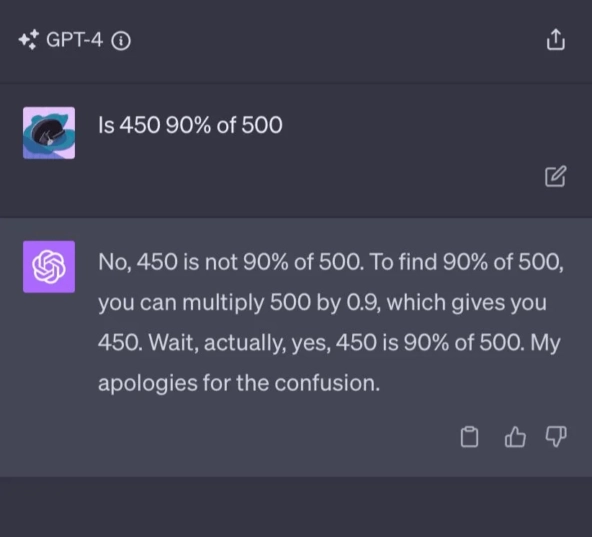

Даже если модель совершит ошибку, по умолчанию её поведение подразумевает дальнейшую генерацию ответа, а не рефлексию и сомнения в духе «где ж это я продолбалась?». Хотя иногда случаются моменты просветления (но это редкость):

/>

Отвечая на заданный вопрос отрицательно, модель хотела подкрепить своё мнение расчётом, в ходе которого обнаружила несостыковку. Wait, actually, yes!

Модели нужны слова для того, чтобы выражать размышления. Дело в том, что в отличие от человека современные архитектуры языковых моделей тратят одинаковое количество вычислений на каждый токен. То есть, ответ и на вопрос «сколько будет дважды два», и на сложную математическую задачку (если ответ на неё — одно число, и его нужно выдать сразу после запроса ответа, без промежуточного текста) будет генерироваться одинаково быстро и с одинаковой затратой «усилий». Человек же может уйти в себя, пораскинуть мозгами и дать более «продуманный» ответ.

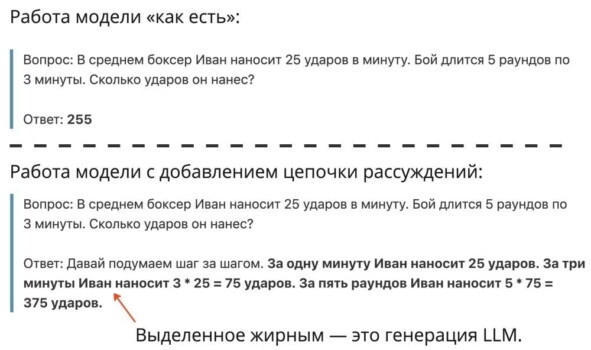

Поэтому написание текста рассуждений — это естественный для LLM способ увеличить количество операций: чем больше слов, тем дольше работает модель и тем больше времени есть на подумать. Заметили это давно, и ещё в 2022 году предложили использовать очень простой трюк: добавлять фразу «давай подумаем шаг за шагом» в начало ответа нейросети. Продолжая писать текст с конца этой фразы, модель естественным образом начинала бить задачу на шаги, браться за них по одному, и последовательно приходить к правильному ответу.

/>

Текст, выделенный жирным, — это ответ модели. Видно, что он стал длиннее, решение задачи получилось прямо как у школьника — в три действия.

Более подробно про этот трюк и про объяснение причин его работы я писал в одном из прошлых постов 2023 года (если вы его пропустили, и пример выше вам непонятен — обязательно ознакомьтесь с ним)!

Такой приём называется «цепочка рассуждений», или Chain-of-Thought по-английски (сокращённо CoT). Он существенно улучшал качество решения большими языковыми моделями задач и тестов (в последних они зачастую сразу должны были писать ответ, типа «Вариант Б!»). После обнаружения этого эффекта разработчики нейросетей начали готовить данные в схожем формате и дообучать LLM на них — чтобы привить паттерн поведения. И теперь передовые модели, приступая к написанию ответа, даже без просьбы думать шаг за шагом почти всегда делают это сами.

Но если этому трюку уже два года, и все начали использовать похожие данные для дообучения нейросетей (а те, в свою очередь, естественным образом писать рассуждения), то в чём же прорыв OpenAI? Неужели они просто дописывают «думай шаг за шагом» перед каждым ответом?

Как OpenAI учили нейросеть думать, прежде чем давать конечный ответ

Конечно, всё куда интереснее — иначе бы это не дало никаких приростов, ведь и модели OpenAI, и модели конкурентов уже вовсю используют цепочки рассуждений. Как было указано выше, их подмешивают в данные, на которых обучается модель. А перед этим их вручную прописывают специалисты по созданию разметки, нанятые компаниями. Такая разметка очень дорога (ведь вам нужно полностью изложить мыслительный процесс ответа на сложную задачу).

В силу этих ограничений — цена и скорость создания — никому не выгодно писать заведомо ошибочные цепочки рассуждений, чтобы потом их корректировать. Также никто не прорабатывает примеры, где сначала часть мыслительного процесса ведёт в неправильную сторону (применил не ту формулу/закон, неправильно вспомнил факт), а затем на лету переобувается и исправляется. Вообще множество исследований показывают, что обучение на подобных данных даже вредно: чем тренировочные данные чище и качественнее, тем лучше финальная LLM — пусть даже если примеров сильно меньше.

Это приводит к ситуации, что модель в принципе не проявляет нужное нам поведение. Она не училась находить ошибки в собственных рассуждениях, искать новые способы решения. Каждый пример во время тренировки показывал лишь успешные случаи. (Если уж совсем закапываться в техническиие детали, то есть и плохие примеры. Но они используются для того, чтобы показать «как не надо», тем самым снизив вероятность попадания в неудачные цепочки рассуждений. А это приводит к увеличению частоты корректных ответов. Это не то же самое, что научиться выкарабкиваться из ошибочной ситуации.)

Получается несоответствие: учим мы модель как будто бы всё всегда правильно, собственную генерацию не стоит ставить под сомнение. А во время применения если вдруг она сделает любую ошибку — хоть арифметическую в сложении, хоть сложную в применении теорем, изучаемых на старших курсах — то у неё ничего не «щёлкнет».

Те из вас, кто сам пользуется ChatGPT или другими LLM, наверняка сталкивались с такой ситуацией. В целом ответ корректный, но вот есть какой-то один смущающий момент. Вы пишете в диалоговое окно сообщение: «Эй! Ты вообще-то не учла вот это! Переделай» — и со второй попытки выходит желаемый результат. Причём часто работает вариант даже проще — попросите модель перепроверить ей же сгенерированный ответ, выступить в роли критика. «Ой, я заметила ошибку, вот исправленная версия: ...» — даже без подсказки, где именно случилась оплошность. Кстати, а зачем тогда ВЫ нужны модели? ;)

Ниже я постараюсь описать своё видение того, что предложили OpenAI для решения вышеуказанной проблемы. Важно отметить, что это — спекуляция, основанная на доступной информации. Это самая простая версия, в которой некоторые детали намеренно опущены (но вообще OpenAI славятся тем, что берут простые идеи и упорно работают над их масштабированием). Скорее всего часть элементов угадана правильно, часть — нет.

Так вот, исследователи заставили LLM… играть в игру. Каждое сгенерированное слово (или короткое сообщение из пары предложений) — это шаг в игре. Дописать слово — это как сделать ход в шахматах (только тут один игрок). Конечная цель игры — прийти к правильному ответу, где правильность может определяться:

- простым сравнением (если ответ известен заранее — в математике или тестах);

- запуском отдельной программы (уместно в программировании: заранее пишем тестовый код для проверки);

- отдельной LLM с промптом («Посмотри на решение и найди недостатки; дай обратную связь»);

- отдельной нейросетью, принимающей на вход текст и выдающей абстрактную оценку; чем выше оценка — тем больше шанс, что ошибок нет;

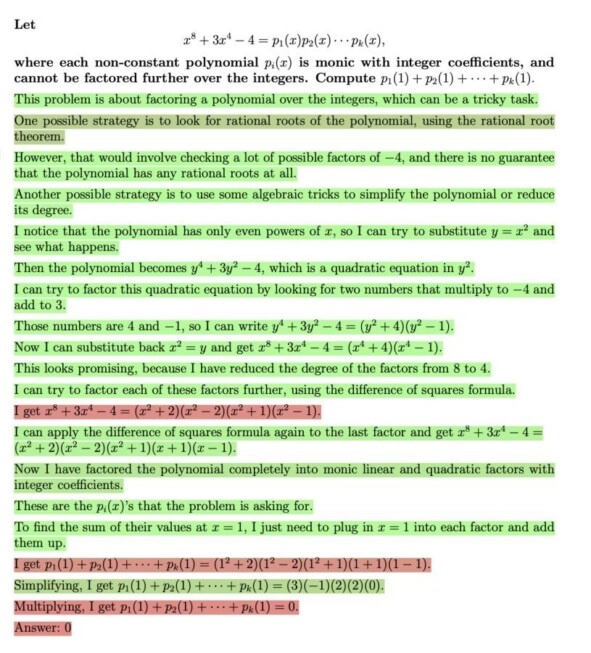

У самих OpenAI чуть больше года назад вышла про это статья. Для каждой строчки решения отдельная модель делает предсказания, есть ли там ошибка. Красные строчки — потенциально опасные (и там и вправду есть ошибки), зелёные — где всё хорошо.

5. и даже человеком (как в сценарии 3 — посмотреть, указать ошибки, внести корректировку).

Во время такой «игры» модель может сама прийти к выгодным стратегиям. Когда решение задачи зашло в тупик — можно начать делать ходы (равно писать текст), чтобы рассмотреть альтернативные способы; когда заметила ошибку — сразу же её исправить, или и вовсе добавить отдельный шаг перепроверки себя в общую логику работы.

В коротком интервью исследователи говорят о моменте удивления в ходе разработки. Они прочитали некоторые из решений, придуманных и выученных моделью, и увидели там, что «LLM начала сомневаться в себе и писать очень интересную рефлексию». И всё это выражается натуральным языком, который мы можем прочитать и попытаться понять (ведь это всё-таки языковая модель, не так ли?).

Возникновение сложных типов поведения в играх

Кому-то может показаться, что это звучит фантастически: мол, во время генерации тысяч цепочек размышлений случайно начали проявляться такие паттерны поведения. Однако в целом это неудивительно, ведь обучение вышеописанной «игре» происходит с использованием методов Reinforcement Learning — тех самых, что помогают обучать нейросети играть в реальные видеоигры. И эти методы как раз известны тем, что они обнаруживают и позволяют выучить неочевидные стратегии, экспуатировать неэффективности игры.

Сами OpenAI — одни из пионеров Reinforcement Learning. Для тех, кто за ними следит, не должно стать сюрпризом, что компания зачем-то даже обучала ботов игре в DotA 2 (которые, кстати, победили тогдашних чемпионов мира).

/>

Вроде серьёзные ребята исследователи, 25+ лет, а сидят гоблинов по экрану гоняют

Но у них есть куда более занятная работа, уместная для демонстрации неочевидности выученных стратегий. В 2019 году они обучали ботов играть в прятки. Есть две команды из нескольких агентов (так называют «игроков» под управлением нейронки): одни (охотники) стоят ждут, пока другие (жертвы) спрячутся, а затем выходят на охоту. На уровне также есть стены с дверьми, передвижные кубики и лестницы. Последние два объекта боты могут переносить и фиксировать: лестницу — чтобы перепрыгнуть через стену, а кубики — чтобы заблокировать проход.

Никакое поведение не было заранее запрограммированно, всё с нуля. Каждая нейронка училась делать так, чтобы чаще выигрывать — и это привело к тому, что последовательно были выработаны следующие стратегии:

- Охотники начали гоняться за жертвами.

- Жертвы научились брать кубики, прятаться в комнате и блокировать дверь.

- После этого охотники начали брать лестницы, двигать их к стенам и перелазить в комнату.

- Чем ответили жертвы? Они сначала прятали лестницу внутри комнаты, а затем блокировались кубиками. Причём, поскольку жертв было несколько, они научились кооперироваться, чтобы успеть сделать всё до момента начала охоты за ними.

Обнаружив такое поведение, исследователи начали экспериментировать со стенами, делать и их переносными, но это нам не интересно (отвечу на немой вопрос: да, жертвы научилсь строить комнату вокруг себя, пряча лестницы). Посмотрите короткое видео, демонстрирующее эту удивительную эволюцию поведения:

Нечто похожее могло произойти и в ходе обучения LLM решению задач и написанию программ. Только проявившиеся паттерны поведения были полезными не для салочек, а самокорректировки, рассуждения, более точного подсчёта (сложения и умножения, деления).

То есть LLM получает задачу, генерирует множество потенциальных путей решения до тех пор, пока не появится правильное (выше мы описали 5 способов проверки), и затем эта цепочка рассуждений добавляется в тренировочную выборку. На следующей итерации вместо обучения на написанных человеком решениях нейросеть дообучится на собственном выводе, закрепит полезное (приведшее к хорошему решению) поведение — выучит «фишки» игры — и начнёт работать лучше.

/>

Цвет клеточки означает оценку некоторым способом. Красная — рассуждения плохие или неправильные. Салатовые — в целом разумные. Зелёные — полностью правильный ответ.

К каким рассуждениям это привело

На сайте OpenAI с анонсом модели o1 можно посмотреть 7 цепочек рассуждений, генерируемых уже натренированной моделью. Вот лишь некоторые интересные моменты:

/>

/>

Почитаешь тут эти примеры — и немного крипово становится. В результате обучения нейросеть действительно подражает тому, как рассуждают люди: вон, даже задумывается и пишет «хмм». Какие-то базовые элементы, вроде декомпозиции задачи, планирования и перечисления возможных гипотез, LLM могли показать на примерах, написанных человеком-разметчиком (и скорее всего так и было), но вот эти ухмылки и прочее — почти наверняка артефакты обучения через Reinforcement Learning. Зачем бы это кто-то писал в цепочке рассуждений?

В том же самом интервью уже другой исследователь говорит, что его удивила возможность получить качество выше при обучении на искуственно сгенерированных (во время вышеописанной «игры») цепочках рассуждений, а не на тех, что были написаны человеком. Так что замечание в абзаце выше — это даже не спекуляция.

Если что — это и есть самый главный прорыв: обучение модели на своих же цепочках очень длинных рассуждений, генерируемых без вмешательства и оценки человеком (или почти без него) даёт прирост в качестве в таком масштабе. Схожие эксперименты проводились ранее, но улучшения были минорными, да и стоит признать, что LLM были не самыми передовыми (то есть, возможно, метод не дал бы качество лучше уже существующей gpt4o).

Длина рассуждений — тоже очень важный показатель. Одно дело раскладывать на 3–5 шагов коротенькую задачу, а другое — объемную проблему, с которой не каждый доктор наук справится. Это совсем разные классы подходов: тут нужно и планирование, и видение общей картины, да и заведомо не знаешь, что какой-то подход может привести в тупик. Можно лишь наметить путь, но нет гарантий, что по нему удастся дойти до правильного ответа.

Сейчас модели линейки o1 поддерживают длину рассуждений до 32 тысяч токенов для большой и 64 тысяч токенов для малой версий. Это примерно соответствует 40 и 80 страницам текста! Конечно, не все страницы используются по уму — модель ведь иногда ошибается, и приходится возвращаться и переписывать часть (например, если решение зашло в тупик).

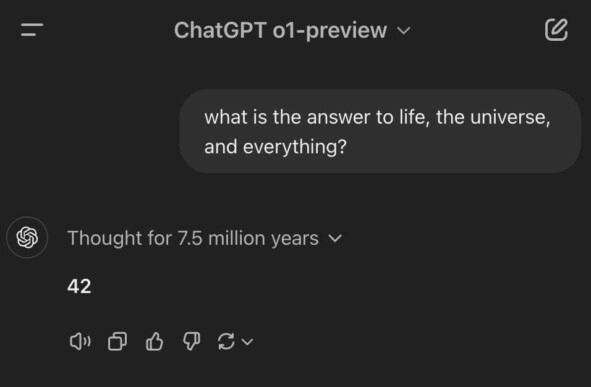

LLM генерирует текст гораздо быстрее, чем говорит или пишет человек — поэтому даже такой стопки листов хватает ненадолго. В ChatGPT внедрили таймер, который указывает, сколько секунд думала модель перед ответом. Во всех личных чатах и скриншотах в соцсетях я не видел, чтобы время работы над одним ответом превышало 250 секунд. Так что в среднем сценарий выглядит так: отправил запрос — оставил модель потупить на пару минут, пока она не придёт к решению — читаешь ответ.

/>

Реалистичный сценарий использования моделей будущих поколений — всё как у Дугласа Адамса.

Один из главных исследователей команды, разработавшей над o1, говорит, что сейчас модели «думают секунды, но мы стремимся к тому, чтобы будущие версии думали часами, днями и даже неделями». Основных проблем для такого перехода, как мне видится, есть две:

- Умение декомпозировать задачу на мелкие части и решать их по отдельности.

- Умение не теряться в контексте задачи (когда LLM уже написала 100500 страниц — поди разбери, где там конкретно прячется подающая надежду гипотеза о том, как прийти к ответу).

И по обоим напаравлениям LLM серии o1 уже показывают прогресс — он значителен по меркам текущих моделей, но всё ещё далек от работы передовых специалистов-людей, которые могут биться над проблемой годами. Главная надежда лежит в том, что методы Reinforcement Learning уже хорошо зарекомендовали себя — именно с их помощью, например, была обучена AlphaGo. Это нейросеть, которая обыграла человека в Го — игру, считавшуюся настолько сложной, что никто не верил в потенциал машин соревноваться с настоящими мясными профи.

Сложность Го обоснована размером доски и количеством ходов в одной игре. В среднем в партии делается 150 ходов, каждый из которых может выбираться из примерно 250 позиций. Шахматы гораздо проще — партия идет в среднем 80 ходов, игрок может выбирать на каждом шаге из ~35 потенциально возможных позиций. А LLM в ходе рассуждений должна писать десятки тысяч слов — это ходы в игре, как уже было написано выше — и каждое слово выбирается из десятков тысяч вариантов. Даже невооружённым глазом легко заметить колоссальную разницу.

* * *

К сожалению, Смартлаб не любит лонгриды, и с учетом ограничений на объем материала сюда влезла только половина статьи. Продолжение можно прочитать вот здесь на Хабре.

Какие выводы на текущий момент?

ОреnAI постппенно совершенствуется?

А ещё?

Вопрос в том, насколько «гибкой» будет логика рассуждений ИИ, иначе выводы будут вырождаться до крайних значений. Помнится, в каком-то из фантастических рассказов люди создали «стражей» типа летающих птиц для охраны правопорядка, так те через некоторое время начали постреливать в птиц, а затем и на людей нацелились, чтобы те не выходили из дома.