Драма Сэма Альтмана указывает на более глубокий раскол в мире технологий. Думеры и бумеры борются за доминирование в ИИ и будущие доходы

Рифтовая долина

Нет никаких сомнений в преданности Сэма Альтмана Openai, фирме, стоящей на переднем крае революции в области ИИ. В качестве соучредителя и руководителя он, похоже, работал так же неустанно ради успеха, как и в предыдущем стартапе, где его целеустремленность привела к приступу цинги, болезни, которая чаще всего ассоциируется с моряками ушедшей эпохи, которые слишком долго оставались в море, не имея доступа к свежей еде. Поэтому его внезапное увольнение 17 ноября стало шоком.

Причины, по которым совет директоров фирмы потерял доверие к Альтману, неясны. Слухи указывают на беспокойство по поводу его побочных проектов и опасения, что он слишком быстро продвигался к расширению коммерческих предложений Openai, не принимая во внимание последствия для безопасности, в фирме, которая также пообещала развивать технологию для «максимального блага человечества».

Инвесторы компании и некоторые ее сотрудники теперь добиваются восстановления Альтмана на работе. Независимо от того, добьются они успеха или нет, ясно, что события в Опенай являются самым драматичным проявлением более широкого раскола в Кремниевой долине.

На одной стороне находятся думеры («обреченники»), которые считают, что, если не контролировать ИИ, он представляет экзистенциальную угрозу человечеству, и поэтому выступают за более строгие правила.

Им противостоят «бумеры», которые преуменьшают страх перед апокалипсисом ИИ и подчеркивают его потенциал для ускорения прогресса.

Лагерь, который окажется более влиятельным, может либо поощрять, либо препятствовать ужесточению регулирования, что, в свою очередь, может определить, кто больше всего получит выгоду от ИИ в будущем.

Корпоративная структура Openai преодолевает этот разрыв. Основанная как некоммерческая организация в 2015 году, компания три года спустя создала коммерческую дочернюю компанию для финансирования своих потребностей в дорогостоящих вычислительных мощностях и интеллектуальных силах для продвижения технологии вперед. Удовлетворение конкурирующих целей думеров и бумеров всегда было трудным.

Раскол частично отражает философские разногласия. Многие в лагере думеров находятся под влиянием «эффективного альтруизма» — движения, которое обеспокоено возможностью уничтожения всего человечества с помощью искусственного интеллекта. В число вызывающих беспокойство входит Дарио Амодей, который покинул OpenAI, чтобы запустить Anthropic, еще одного производителя моделей. Другие крупные технологические компании, в том числе Microsoft и Amazon, также обеспокоены безопасностью ИИ.

Бумеры поддерживают мировоззрение, называемое «эффективным акселерационизмом», которое утверждает, что развитию искусственного интеллекта следует не только позволить беспрепятственно, но и ускорить его.

Возглавляет инициативу Марк Андриссен, соучредитель компании венчурного капитала Andreessen Horowitz. Другие ученые, похоже, сочувствуют этому делу. Янн Лекун и Эндрю Нг из Meta, а также множество стартапов, включая Hugging Face и Mistral ai, выступают за менее строгое регулирование.

Альтман, похоже, симпатизировал обеим группам, публично призывая к созданию «ограждений», чтобы сделать ИИ безопасным, одновременно подталкивая Openai к разработке более мощных моделей и запуску новых инструментов, таких как магазин приложений, позволяющий пользователям создавать своих собственных чат-ботов.

Ее крупнейший инвестор, Microsoft, которая вложила в Openai более $10 млрд за 49% акций, не получив ни одного места в совете директоров материнской компании, как сообщается, недовольна, узнав об увольнении всего за несколько минут до того, как об этом узнал Альтман. Если он не вернется, вполне вероятно, что Опенай более твердо встанет на сторону думеров (обреченных).

Однако, похоже, здесь происходит нечто большее, чем просто абстрактная философия. Как оказалось, эти две группы также разделены по более коммерческим направлениям.

Думеры являются первопроходцами в гонке ИИ, у них более глубокие карманы и они поддерживают запатентованные модели.

С другой стороны, бумеры, скорее всего, будут догоняющими фирмами, меньшими по размеру и предпочитающими программное обеспечение с открытым исходным кодом.

Начнем с первых.

Chatgpt Openai добавил 100 миллионов пользователей всего за два месяца после запуска, за ним следует Anthropic, основанная перебежчиками из Openai и сейчас оцениваемая в 25 миллиардов долларов. Исследователи из Google написали оригинальную статью о больших языковых моделях, программном обеспечении, которое обучается на огромных объемах данных и лежит в основе чат-ботов, включая Chatgpt. Фирма выпускает более крупные и умные модели, а также чат-бота Bard.

Между тем, лидерство Microsoft во многом основано на ее большой ставке на Openai. Amazon планирует инвестировать в Anthropic до $4 млрд. Но в сфере технологий движение первым не всегда гарантирует успех. На рынке, где технологии и спрос быстро развиваются, у новых участников есть широкие возможности потеснить действующих игроков.

Это может придать дополнительную силу стремлению сторонников ужесточения правил. Выступая перед американским Конгрессом в мае, Альтман выразил опасения, что эта отрасль может «нанести значительный вред миру», и призвал политиков принять конкретные правила для ИИ.

В том же месяце группа из 350 учёных и технических руководителей, в том числе из Openai, Anthropic и Google, подписала однострочное заявление, предупреждающее о «риске исчезновения», который ИИ представляет наравне с ядерной войной и пандемиями. Несмотря на ужасающие перспективы, ни одна из компаний, поддержавших это заявление, не приостановила свою работу по созданию более мощных моделей ИИ.

Политики изо всех сил стараются показать, что они серьезно относятся к рискам. В июле администрация президента Джо Байдена подтолкнула семь ведущих производителей моделей, в том числе Microsoft, Openai, Meta и Google, к взятию на себя «добровольных обязательств» по проверке их ИИ-продуктов экспертами перед выпуском их для широкой публики.

1 ноября британское правительство заставило аналогичную группу подписать еще одно необязывающее соглашение, которое позволяло регулирующим органам проверять их продукты искусственного интеллекта на предмет надежности и вредоносных возможностей, таких как угроза национальной безопасности. За несколько дней до этого Байден издал гораздо более резкий указ. Он обязывает любую компанию, занимающуюся искусственным интеллектом, которая создает модели сверх определенного размера (определяемого вычислительной мощностью, необходимой для программного обеспечения), уведомлять правительство и делиться результатами испытаний на безопасность.

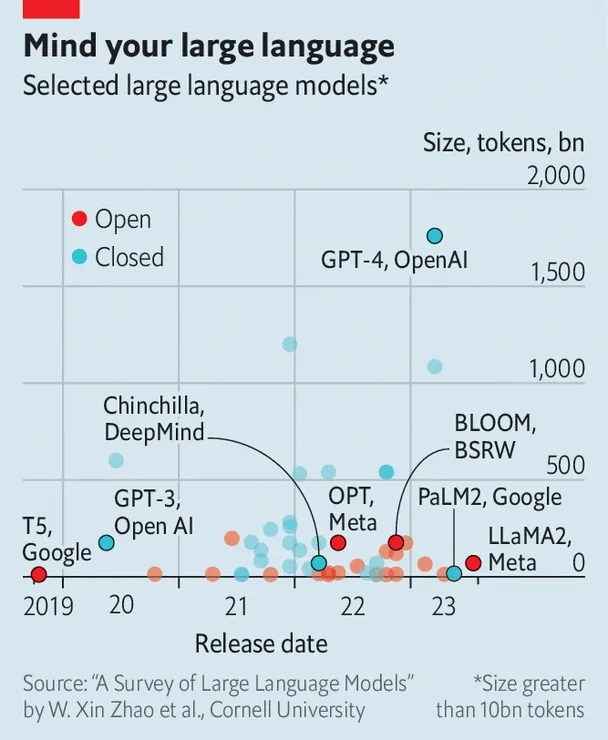

Еще одна линия разногласий между этими двумя группами — будущее искусственного интеллекта с открытым исходным кодом. Модели были либо проприетарными, как у Openai, Anthropic и Google, либо открытыми. Выпуск в феврале модели llama, созданной Meta, стимулировал активность в области искусственного интеллекта с открытым исходным кодом (см. диаграмму).

Сторонники утверждают, что модели с открытым исходным кодом более безопасны, поскольку они открыты для проверки. Недоброжелатели опасаются, что обнародование этих мощных моделей ИИ позволит злоумышленникам использовать их в злонамеренных целях.

Но спор по поводу открытого исходного кода может также отражать коммерческие мотивы. Венчурные капиталисты, например, являются его большими поклонниками, возможно, потому, что они подсматривают способ для стартапов, которые они поддерживают, догнать передовые рубежи или получить свободный доступ к моделям. Действующие игроки могут опасаться конкурентной угрозы.

В опубликованной в мае записке, написанной инсайдерами Google, признается, что модели с открытым исходным кодом достигают результатов в некоторых задачах, сравнимых с результатами их проприетарных собратьев, и их создание обходится гораздо дешевле. В меморандуме делается вывод, что ни у Google, ни у Openai нет защитного «рва» против конкурентов с открытым исходным кодом.

Пока регуляторы, похоже, восприимчивы к аргументам обреченных. Указ Байдена может затормозить развитие ИИ с открытым исходным кодом. Широкое определение моделей «двойного назначения», которые могут иметь как военные, так и гражданские цели, в приказе налагает сложные требования к отчетности для производителей таких моделей, которые со временем могут также охватывать модели с открытым исходным кодом. Степень, в которой эти правила могут быть соблюдены сегодня, неясна. Но со временем они могут нарастить зубы, скажем, если будут приняты новые законы.

Не каждая крупная технологическая фирма попадает по обе стороны этой границы. Решение Meta открыть исходный код своих моделей искусственного интеллекта сделало ее неожиданным лидером среди стартапов, предоставив им доступ к мощной модели, на основе которой можно создавать инновационные продукты.

Meta делает ставку на то, что всплеск инноваций, вызванный инструментами с открытым исходным кодом, в конечном итоге поможет ей, создавая новые формы контента, которые будут привлекать пользователей и радовать рекламодателей.

Apple является еще одним исключением. Крупнейшая в мире технологическая фирма особенно молчат об искусственном интеллекте. При запуске нового iPhone в сентябре компания продемонстрировала многочисленные функции искусственного интеллекта, не упомянув сам термин. Когда ее подталкивают, ее руководители склонны превозносить «машинное обучение» — еще один термин, обозначающий искусственный интеллект.

Это выглядит умно.

Крах в Опенай показывает, насколько разрушительными могут быть культурные войны из-за ИИ.

Но именно эти войны будут определять, как будут развиваться технологии, как они будут регулироваться и кто уйдет с добычей.

Еще по теме ИИ: Как будет развиваться ИИ в 2024 году: модели ИИ станут меньше и быстрее. Они улучшатся и во многих других отношениях.

Генеративный ИИ станет мейнстримом в 2024 году. Компании, разбирающиеся в данных, выиграют в первую очередь

Что будет означать ИИ для вашей зарплаты? Сообщение от отраслей, находящихся на переднем крае экономических преобразований

Что нужно, чтобы Россия стала одним из мировых IT-центров

Nvidia оценивается в триллион $. Как удалось достичь таких высот производителю микросхем? Какие у нее ограничения и кто ее конкуренты

P. S. Подпишитесь на канал «Куда идем? — будьте в курсе главного, что определяет нашу жизнь: политика, экономика, технологии. Подписывайтесь еще и на мой Телеграмм